Variance et écart-type

On peut définir les statistiques descriptives comme l'art de perdre de nombreux chiffres (les données brutes) pour en obtenir quelques autres (des indicateurs qui résument la distribution). Parmi ceux-ci, les indicateurs de dispersion occupent une place de choix...

Dispersion

La dispersion est un élément essentiel de l'analyse d'une série statistique quantitative. C’est la mesure de l’étalement des valeurs d'une variable statistique, de part et d’autre d’une position centrale (moyenne ou plus rarement médiane). Cet étalement caractérise un échantillon ou une population et permet des comparaisons : à effectif égal, les âges des élèves d’un lycée sont moins dispersés que ceux des habitants d’un village.

Note : pour une première approche de ce thème, en particulier si vous êtes dans le secondaire, lisez plutôt la page d'initiation aux paramètres de dispersion.

Indicateurs simples

Parmi les indicateurs les plus faciles à calculer, on retiendra l'étendue et l'écart absolu moyen (EAM). Les quantiles (quartiles, déciles et centiles) permettent eux aussi de juger la dispersion d’une distribution, particulièrement lorsque celle-ci n'est pas symétrique, mais leur interprétation est moins immédiate.

Les diagrammes en boîtes sont des outils visuels qui reprennent ces indicateurs. Leur intérêt apparaît surtout lorsqu'on compare plusieurs distributions.

Variance et écart-type

Vous les attendiez tous : la variance, c’est-à-dire l'espérance des carrés des écarts à la moyenne, et sa racine carrée, l'écart-type, qui est donc la moyenne quadratique des écarts à la moyenne.

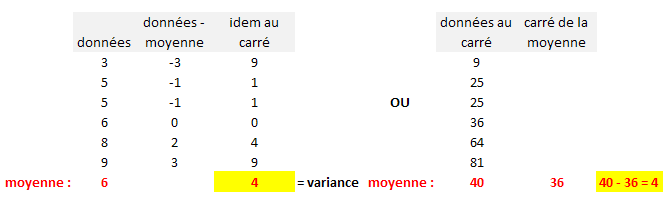

La variance est donc laborieuse à calculer mais il existe un raccourci, développé en page de propriétés de la variance : la moyenne des carrés moins le carré de la moyenne.

L'écart-type est noté avec un sigma minuscule (\(\sigma\)). Le terme et le symbole sont dus à Karl Pearson (1893). Sur un échantillon, on le note souvent \(s\). Voir la page sur la notation statistique.

L'écart-type est dans la même unité de mesure que les données. Même avec peu d'habitude, il est donc assez simple à interpréter. En revanche, la variance a davantage sa place dans les étapes intermédiaires de calcul que dans un rapport.

Sur un échantilon statistique dont l'effectif est \(n,\) la formule de la variance est donc la suivante :

\[{s _x}^2 = \frac{1}{n}{\sum\limits_{i = 1}^n {\left( {{x_i} - \overline x } \right)} ^2}\]

Ci-dessous, un exemple simple de calcul manuel montre les deux chemins qui mènent à la variance. Voir aussi l'exemple détaillé en bas de page d'exercice sur série discrète et les contributions à la variance.

Si l'on calcule la variance d'une variable statistique, on peut aussi bien calculer celle d'une variable aléatoire. Les carrés des écarts sont alors pondérés par des probabilités :

\[V(X) = {\sum\nolimits_{{x_i}} {{p_i}\left( {{x_i} - \mu } \right)} ^2}\]

On peut aussi écrire \(V(X) = E\left( {{{\left( {X - E(X)} \right)}^2}} \right)\).

Souvent, les lois de probabilité qui résument les distributions de ces variables se présentent sous forme de fonctions continues. Qu'à cela ne tienne, elles ont aussi leur variance.

\[V(X) = \int\limits_{ - \infty }^{ + \infty } {\left( {{{\left( {x - E(X)} \right)}^2}} \right)} f(x)dx\]

\(E(X)\) est l’espérance mathématique et \(f\) la densité de probabilité. La variance est définie par une intégrale généralisée. Donc, elle n'existe pas si l'intégrale diverge (loi de Cauchy, notamment).

Si la distribution est centrée, les choses sont encore plus simples puisque la moyenne vaut 0. La variance est donc égale à la moyenne des carrés (voir le MSE). Une variable centrée est réduite lorsqu'elle est divisée par son écart-type.

Petit aparté dont la portée est très importante en statistiques : comme la variance est un carré, elle est géométriquement assimilable à une distance euclidienne et peut être décomposée comme étant une hypoténuse. Ainsi une régression apparaît comme une décomposition en variance expliquée et variance résiduelle. Dans la mesure où il s’agit du carré d’une distance par rapport à un point (la moyenne), la variance est assimilable à une inertie sans pondération. Les k-means reposent sur la décomposition de cette inertie, intra et extra classes. Dans un échantillon stratifié, la variance d’un estimateur se décompose en intra et extra strate. Entre autres utilités...

Quelques inconvénients

La variance n'est pas un indicateur très robuste aux valeurs aberrantes qui ont un poids relativement élevé puisque ce sont les carrés des distances qui sont utilisés. Par ailleurs, la moyenne qui intervient dans le calcul de la variance est elle-même peu robuste (inconvénient bien connu).

Autre hic : contrairement à la moyenne, variance et écart-type présentent un biais s'ils sont calculés sur un échantillon aléatoire pour être estimés sur toute la population. Intuitivement, on devine que la dispersion globale est sous-estimée sur un échantillon. Du coup, les logiciels calculent l’écart-type comme si c’était le paramètre d’un échantillon (paramètre empirique) mais il arrive qu’il soit calculé comme celui d’une population totale et l'on peut obtenir des résultats différents avec des données identiques en passant, par exemple, d’un logiciel à une calculatrice ! Pour Excel, la fonction ECARTYPE correspond au sans biais ; c’est la fonction ECARTYPEP que vous devez utilisez sur une population totale (et VAR.P pour la variance).

Rappelons la formule de l'écart-type (ou l'une des formules puisqu'il en existe plusieurs équivalentes) :

\[s = \sqrt {\frac{{{{\sum {\left( {{x_i} - \overline x } \right)} }^2}}}{n}} \]

L’écart-type sans biais :

\[s = \sqrt {\frac{{{{\sum {\left( {{x_i} - \overline x } \right)} }^2}}}{{n - 1}}} \]

Il est clair que plus l'effectif est important, moins la différence est significative.

Exemple : la série 1, 2, 3, 4, 5, 6, 7, 8, 9, 10 a pour moyenne 5,5, pour écart-type empirique 2,87, pour écart-type sans biais 3,03 et pour EAM 2,5. L’écart-type est supérieur à l’EAM puisqu'il retient les carrés des écarts. Les valeurs éloignées de la moyenne, notamment 1 et 10, ont donc un poids plus important que les valeurs 5 et 6 qui en sont proches. Si vous ignorez quel écart-type est calculé par vos logiciels ou votre calculatrice, entrez ces chiffres, par curiosité…

Un moyen de tester la qualité des algorithmes de votre logiciel consiste à calculer l’écart-type empirique entre deux nombres proches, mettons 1 et 2, puis à ajouter des puissances de 10 (1 000 001 et 1 000 002...) de plus en plus élevées et à vérifier que le résultat reste le même. Il arrive un moment où le logiciel finit par donner zéro…

C'est l'écart-type biaisé qui est utilisé dans les formules de statistique descriptive, par exemple celle du coefficient de régression linéaire ou du coefficient de variation.

Le coefficient de variation

Voir le coefficient de variation.